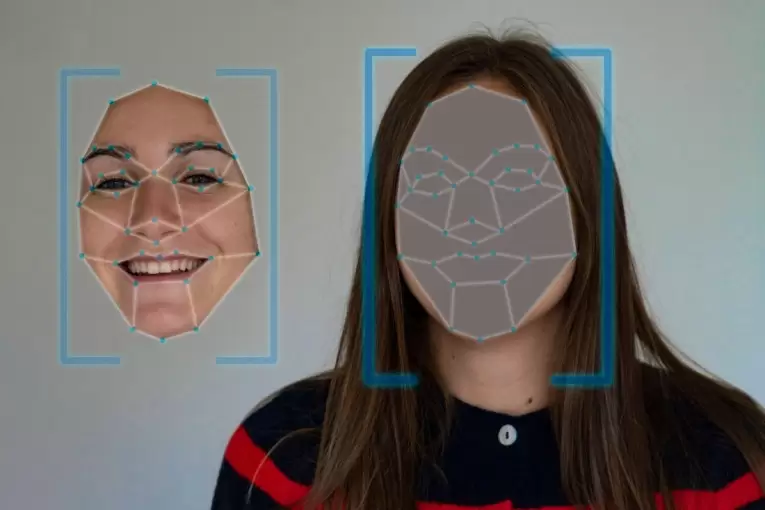

Deepfake tehnologija predstavlja sve napredniji izazov u digitalnom dobu. Ova tehnika omogućava stvaranje visokorealističnih lažnih sadržaja, posebno video i audio materijala, koristeći napredne tehnike obrade podataka i veštačke inteligencije. Iako je ova tehnologija korisna u raznim oblastima, od zabave do medicinske dijagnostike, postoje i ozbiljni rizici, naročito u sferi lažiranja informacija.

Kako se prepoznaje Deepfake

Nedoslednosti u izrazima lica: Deep fake često ima poteškoće u reprodukciji prirodnih izraza lica. Pogreške u pokretima očiju, usana ili mimici mogu ukazivati na lažni sadržaj.

Problemi s pozadinom: Deep fake često ima izazove u reprodukciji realističnih pozadina. Neujednačenost u svetlu, senkama i detaljima može odati prisutnost manipulacije.

Anomalije u pokretima: Lažni sadržaj može pokazivati čudne pokrete, posebno u brzim ili kompleksnim scenama. Ovo uključuje nesavršenosti u sinhronizaciji pokreta tela i govora.

Analiza autentičnosti audio zapisa: Deep fake tehnologija može stvoriti lažne audio zapise. Analiza frekvencija, ritma i drugih karakteristika zvuka može pomoći u prepoznavanju ovakvih manipulacija.

Obrazovanje i svest o mogućem postojanju: Informisanje o postojanju deep fake tehnologije i rizicima koje nosi ključno je za svakog korisnika. Razumevanje kako funkcioniše ovakva tehnologija pomaže u prepoznavanju potencijalno lažnih sadržaja.

Korišćenje pouzdanih izvora: Verifikovanje izvora informacija može značajno smanjiti rizik od izloženosti deepfake sadržaju. Pratite proverene medijske kanale i izbegavajte sumnjive izvore.

Korišćenje tehnologije za prepoznavanje: Razvoj tehnologija za prepoznavanje deepfake sadržaja može biti koristan. Ovo uključuje softvere i alatke koje analiziraju vizuelne i zvučne elemente kako bi identifikovali potencijalno lažne sadržaje.

Jačanje sigurnosti online naloga: Korišćenje snažnih lozinki, dvofaktorske autentifikacije i redovno ažuriranje bezbednosnih postavki može smanjiti rizik od hakovanja i manipulacije sadržajem

Deca najugroženija

Katarina Jonev, edukator o sigurnosti dece na internetu, osvrnula se na užasavajuću mogućnost da kriminalci mogu da zloupotrebe slike naših najmlađih:

– Softer potencijalno može da iskoristi fotografiju ili video-zapis koji su dostupni na društvenim mrežama bilo kog deteta i da ga pretvore u sadržaj dečje pornografije! – napisala je ona na svom Instagram profilu i dodala:

– Deepfake može da se koristi za kreiranje lažnih pornografskih slika ili video zapisa (što je u praksi poznato i kao „deep porn“). Deepfake olakšava sajber nasilnicima i predatorima da kreiraju ubedljive lažne slike ili video zapise kako bi ponizili ili maltretirali svoje žrtve. Deca i tinejdžeri su posebno ranjivi, jer tehnologija može imati razorne posledice po njihovo mentalno zdravlje, bezbednost, privatnost, dostojanstvo!

Deep fake tehnologija predstavlja izazov koji zahteva kombinaciju tehnoloških rešenja i obrazovanja korisnika. Svest o ovom fenomenu, kritičko razmišljanje i praćenje bezbednosnih praksi ključni su elementi u zaštiti od potencijalno štetnih deepfake sadržaja.